تنتشر مقاطع فيديوهات الذكاء الاصطناعي المُضللة بوتيرة متسارعة على منصات التواصل الاجتماعي، مما يثير قلقاً متزايداً بشأن انتشار المعلومات الكاذبة والتأثير على الرأي العام. وقد ظهرت أمثلة حديثة، مثل فيديو مُفبرك على تطبيق “تيك توك” يُظهر مقابلة وهمية حول بيع قسائم الطعام، وفيديوهات أخرى انخدعت بها وسائل إعلام كبرى، لتسلط الضوء على سهولة التلاعب بالواقع باستخدام هذه التقنيات.

في أكتوبر الماضي، لفت انتباه المستخدمين فيديو انتشر على “تيك توك” يدعي أنه يصور مقابلة مع امرأة حول بيع قسائم الطعام مقابل المال، وهو ما يمثل جريمة. تبين لاحقاً أن الفيديو بالكامل تم إنشاؤه بواسطة الذكاء الاصطناعي، وأن المرأة والمقابلة لم يكونا حقيقيين. كما وقعت قناة “فوكس نيوز” في فخ فيديو مماثل، واعتبرته دليلاً على الغضب الشعبي، قبل أن تقوم بحذف المقال لاحقاً.

تزايد خطر فيديوهات الذكاء الاصطناعي المُضللة

تُظهر هذه الحوادث مدى سهولة استخدام أدوات الذكاء الاصطناعي، مثل تطبيق “سورا” من “أوبن إيه آي”، لإنشاء محتوى مُضلل يبدو واقعياً للغاية. وقد انتشرت هذه المقاطع بشكل واسع على منصات رئيسية مثل “تيك توك” و”إكس” و”يوتيوب” و”فيسبوك” و”إنستغرام” خلال الشهرين الماضيين، وفقاً لخبراء متخصصين في رصد هذه الظاهرة. ويثير هذا الانتشار مخاوف بشأن جيل جديد من المعلومات المضللة والأخبار الكاذبة التي قد تؤثر على النقاشات السياسية والاجتماعية.

عدم كفاية الإجراءات الحالية

تتبنى معظم شركات التواصل الاجتماعي سياسات تتطلب الإفصاح عن استخدام الذكاء الاصطناعي وتحظر المحتوى الذي يهدف إلى التضليل. ومع ذلك، يرى الخبراء أن هذه الضوابط غير كافية لمواكبة التطورات التكنولوجية السريعة. فبينما يركز بعض المحتوى على السخرية أو إنشاء صور مُفبركة، فإن البعض الآخر يهدف إلى تأجيج الكراهية أو التأثير على الرأي العام في قضايا سياسية.

مسؤولية شركات التواصل الاجتماعي

يؤكد الباحثون أن المسؤولية تقع الآن على عاتق شركات التواصل الاجتماعي لاتخاذ خطوات أكثر فعالية لضمان تمييز المستخدمين بين المحتوى الحقيقي والمزيف. ويقول سام غريغوري، المدير التنفيذي لمنظمة “ويتنس”، إن هذه الشركات تحتاج إلى تحسين إدارة المحتوى ومكافحة المعلومات المضللة بشكل استباقي، بدلاً من الاعتماد على المستخدمين للإبلاغ عن المحتوى غير الحقيقي.

وتواجه هذه الشركات تحدياً كبيراً في اكتشاف المحتوى المُنشأ بواسطة الذكاء الاصطناعي وتصنيفه بشكل دقيق. وعلى الرغم من وجود تقنيات يمكن أن تساعد في ذلك، إلا أنها لا تُستخدم دائماً بشكل فعال أو فوري.

جهود الشركات المطورة لأدوات الذكاء الاصطناعي

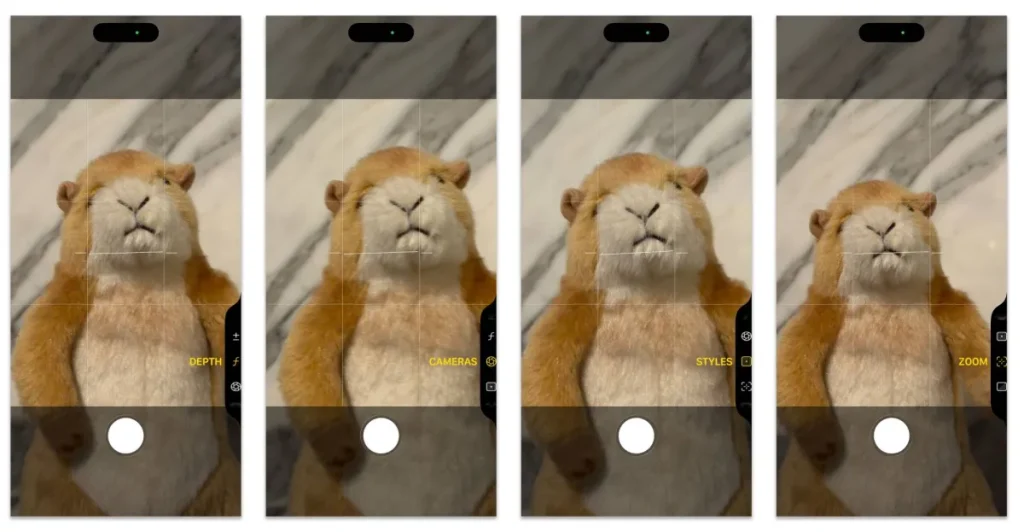

تحاول الشركات المطورة لأدوات الذكاء الاصطناعي، مثل “أوبن إيه آي” و”غوغل”، توضيح طبيعة المحتوى المُنشأ بواسطة الكمبيوترات. وتقوم هذه الشركات بوضع علامات مائية مرئية وبيانات وصفية غير مرئية على مقاطع الفيديو التي تنتجها، بهدف إعلام المستخدمين بأن ما يشاهدونه ليس حقيقياً وتزويد المنصات بالإشارات اللازمة لكشفها تلقائياً. وقد أعلنت “تيك توك” عن تشديد قواعدها المتعلقة بالإفصاح عن استخدام الذكاء الاصطناعي وتقديم أدوات جديدة لمساعدة المستخدمين على تحديد مقدار المحتوى المُصطنع الذي يرغبون بمشاهدته.

سهولة التحايل على العلامات

ومع ذلك، يرى الخبراء أن هذه الإجراءات ليست كافية، حيث يمكن للمستخدمين ذوي النوايا الخبيثة التحايل على هذه العلامات بسهولة عن طريق إزالتها أو التلاعب بالفيديوهات. وقد اكتشفت صحيفة “نيويورك تايمز” عشرات الأمثلة على فيديوهات “سورا” التي تظهر على “يوتيوب” من دون العلامة المائية الآلية.

تأثير فيديوهات الذكاء الاصطناعي على الرأي العام

وفقاً لتحليل التعليقات الذي أجرته صحيفة “نيويورك تايمز”، فإن ما يقرب من ثلثي المستخدمين الذين علقوا على فيديو “تيك توك” حول قسائم الطعام تعاملوا معه كما لو كان حقيقياً. ويؤكد هذا على مدى سهولة خداع المشاهدين بالمحتوى المُنشأ بواسطة الذكاء الاصطناعي.

تُقر “أوبن إيه آي” بأنها تحظر الاستخدامات الخادعة أو المضللة لـ”سورا” وتتخذ إجراءات ضد المخالفين. لكنها تشير أيضاً إلى أن هناك العديد من الأدوات المماثلة التي لا تطبق أي ضمانات أو قيود على الاستخدام.

وفي الختام، يظل التحدي قائماً أمام شركات التواصل الاجتماعي والمطورين في مكافحة انتشار فيديوهات الذكاء الاصطناعي المُضللة. من المتوقع أن تشهد هذه القضية تطورات مستمرة في الأشهر القادمة، مع ظهور تقنيات جديدة وأساليب أكثر تطوراً للتحايل على الإجراءات الحالية. ويتطلب ذلك جهوداً متواصلة وتعاوناً بين جميع الأطراف المعنية لضمان سلامة المعلومات وحماية الرأي العام.

من المهم مراقبة التطورات التنظيمية المحتملة المتعلقة بالذكاء الاصطناعي، بالإضافة إلى التقدم في تقنيات الكشف عن المحتوى المزيف، في الأشهر القليلة القادمة.